3월 9일, Anthropic이 조용히 공개한 기능 하나가 개발자 커뮤니티를 술렁이게 했다. 이름하여 Claude Code Review. PR(Pull Request)이 열리는 순간, 여러 AI 에이전트가 달려들어 코드를 샅샅이 뒤지고 버그를 찾아낸다. 그런데 이 리뷰 한 번에 $15~25, 한화로 약 2~3만 원이 든다.

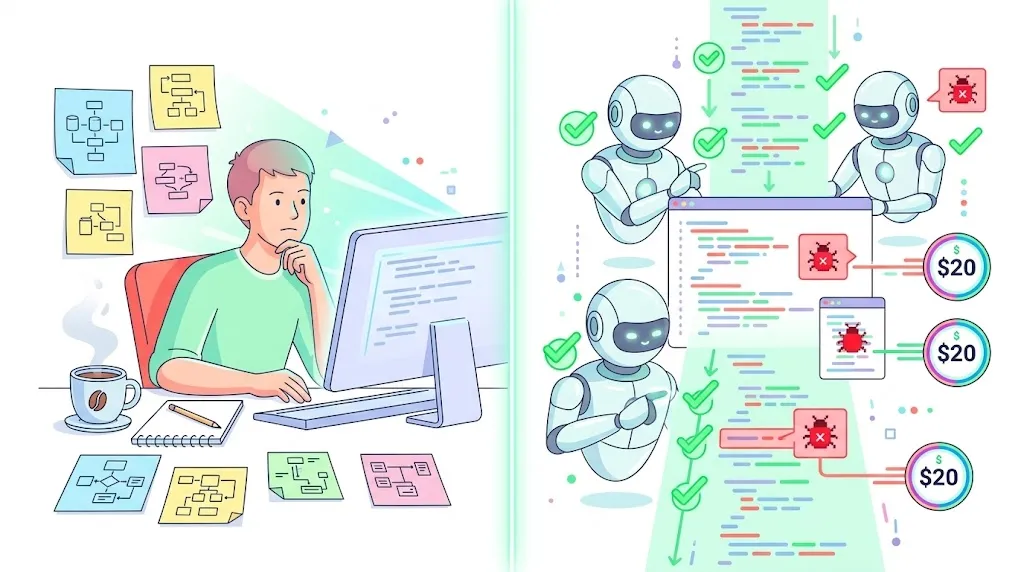

“AI가 짠 코드를 AI가 리뷰한다.” 이 문장이 당신에게 어떻게 들리는가? 효율의 정점인가, 아니면 어딘가 이상한 순환인가?

Claude Code Review, 도대체 어떻게 작동하나

이 기능의 핵심은 멀티 에이전트 병렬 처리다. PR이 열리면 에이전트 팀이 병렬로 코드를 분석하고, 잠재적 버그를 찾은 뒤, 거짓양성(false positive)을 제거하기 위해 서로 교차 검증한다. 최종 결과는 두 가지 형태로 PR에 달린다.

- 요약 댓글: PR 전체에 대한 리뷰 요약

- 인라인 댓글: 특정 버그가 의심되는 코드 라인에 직접 주석

평균 리뷰 시간은 20분. 빠르진 않지만 꼼꼼하다. Anthropic이 공개한 성능 지표를 보면:

대규모 PR (1,000줄 이상 변경)

→ 84%에서 문제 발견, 평균 7.5개 이슈

소규모 PR (50줄 미만 변경)

→ 31%에서 문제 발견, 평균 0.5개 이슈

엔지니어 동의율

→ 발견 이슈 중 1% 미만만 부정확함

정확도 수치는 인상적이다. 논리 오류, 버그, 보안 취약점에 집중하고 스타일 이슈는 의도적으로 배제했다. 코드 포맷이나 네이밍 컨벤션 같은 건 ESLint와 Prettier에게 맡기라는 철학이다.

현재는 Team 및 Enterprise 플랜의 리서치 프리뷰 형태로만 제공된다. 개인 개발자나 소규모 팀은 아직 쓸 수 없다.

PR 한 개에 2만원, 이게 합리적인가

가격 논쟁이 이 기능의 핵심 논란이다. 토큰 기반 과금으로 PR당 평균 $15~25가 청구된다. PR 복잡도와 크기에 따라 달라지지만, 활발한 팀이라면 월 비용이 순식간에 불어난다.

현실적인 계산을 해보자.

팀원 10명, 하루 평균 3개 PR/day

월 PR 수: 10명 × 3 × 22일 = 660 PR/월

리뷰 비용 (평균 $20 기준):

660 × $20 = $13,200/월 ≈ 약 1,850만 원/월

웬만한 스타트업 기준으로 월 1,850만 원은 시니어 개발자 연봉에 맞먹는다. Anthropic이 타겟으로 명시한 Uber, Salesforce, Accenture 같은 대기업이라면 다른 계산이 나올 수 있다. 하지만 이 정도 규모의 기업들은 이미 내부 코드 리뷰 프로세스와 전담 QA 팀이 있다.

비용 통제 장치는 있다. 조직 단위 월간 한도 설정, 저장소별 활성화 여부, 분석 대시보드가 제공된다. 무제한으로 돈이 나가는 구조는 아니다. 하지만 팀이 커질수록 “AI 리뷰가 과연 이 금액만큼의 가치가 있나”라는 ROI 질문을 피하기 어렵다.

AI가 AI를 리뷰한다는 역설

이 기능이 불편하게 느껴지는 이유는 가격 때문만이 아니다. “AI가 AI 코드를 리뷰한다”는 개념 자체가 모순처럼 보이기 때문이다.

Claude Code로 코드를 작성하고, Claude Code Review로 그 코드를 검토한다. 같은 모델 패밀리가 생성과 검토를 모두 담당한다면, 공통적인 편향이나 맹점을 서로 공유하지 않을까? 이를테면 Claude가 특정 패턴으로 반복하는 실수를 Claude Review도 동일하게 놓칠 가능성이 있다.

Anthropic의 주장은 다르다. 리뷰 에이전트가 코드 생성 과정을 모르기 때문에, 결과물만 보고 독립적으로 판단한다는 것이다. 에이전트들이 병렬로 작동하고 서로 검증하는 구조도 이 문제를 어느 정도 완화한다고 설명한다.

그러나 근본적인 질문은 남는다. 인간 개발자의 코드 리뷰는 단순히 버그를 찾는 행위가 아니다. 팀의 코딩 철학을 전달하고, 주니어 개발자가 성장하는 과정이며, 암묵적인 아키텍처 결정을 논의하는 채널이기도 하다. AI가 이 모든 것을 대체할 수 있을까?

# 인간 리뷰어가 할 수 있는 것

# "이 함수, 지금은 동작하지만 6개월 후 우리 아키텍처가

# MSA로 바뀌면 전혀 다른 접근이 필요할 것 같아요"

# AI 리뷰어가 잘하는 것

# "line 42: integer overflow 발생 가능성 있음 (severity: high)"

# "line 78: SQL injection 취약점 감지 (severity: critical)"

논리 오류와 보안 취약점을 잡아내는 건 AI가 탁월하다. 하지만 맥락과 의도와 미래를 함께 읽는 리뷰는 여전히 인간의 영역이다. 두 가지는 보완 관계지, 대체 관계가 아닐 가능성이 높다.

Anthropic이 이 기능을 만든 진짜 이유

타이밍을 봐야 한다. Claude Code가 폭발적으로 성장하면서 기업들의 AI 생성 코드 볼륨이 급격히 늘어나고 있다. Stripe 같은 기업이 주당 1,300개 PR을 AI로 머지하는 세상이다. PR이 폭발적으로 늘어나면 그것을 검토하는 인적 자원이 병목이 된다.

Anthropic은 그 병목을 직접 겨냥했다. “Claude Code가 문제를 만들었으니 Claude Code Review가 그걸 해결한다”는 수직 통합 전략이다. 고객이 Claude Code에 더 많이 의존할수록, Claude Code Review의 필요성도 자연스럽게 올라간다.

이 맥락에서 보면 가격도 다르게 읽힌다. PR당 $15~25는 개발자 시간을 기준으로 보면 저렴하다. 시니어 개발자가 복잡한 PR 하나를 꼼꼼히 리뷰하는 데 20~40분이 걸린다면, 시급으로 환산했을 때 $15~25는 사실 경쟁력 있는 가격이다. 문제는 AI 리뷰가 인간 리뷰를 완전히 대체한다는 전제가 성립해야 한다는 점이다.

개발자로서 어떻게 바라볼 것인가

Claude Code Review는 지금 당장 모든 팀에게 필요한 도구가 아니다. 특히 소규모 팀이나 개인 프로젝트에서는 비용 대비 효과를 정당화하기 어렵다.

그러나 다음 조건이 맞는다면 진지하게 고려할 만하다.

- AI 코드 생성 비율이 높은 팀: Claude Code나 Copilot으로 PR의 절반 이상을 생성한다면

- 코드 리뷰가 병목인 팀: PR 대기열이 길고 리뷰어 시간이 항상 부족하다면

- 보안에 민감한 제품: 결제, 인증, 개인정보처리 코드가 많다면

반대로 이런 팀은 서두를 필요 없다:

- 팀원이 5명 미만이고 PR 볼륨이 적은 경우

- 모든 PR에 충분한 인간 리뷰가 이루어지고 있는 경우

- 비용 관리가 타이트한 스타트업 초기 단계

마치며

Claude Code Review는 불편한 질문을 던진다. AI가 생산성을 높이면, AI가 만들어낸 과부하를 다시 AI가 해결해야 하는 구조가 된다. 그리고 그 사이클마다 비용이 발생한다.

개발자로서 우리가 진짜 물어봐야 할 것은 “AI 리뷰가 인간 리뷰보다 잘하냐”가 아니다. “우리 팀의 코드 품질과 속도를 동시에 높이는 데 이 도구가 어떤 역할을 할 수 있냐”다.

PR 한 개에 2만 원이 아깝지 않을 팀은 분명 있다. 그 팀이 당신의 팀인지 아닌지, 지금 한번 따져볼 시점이다.